作为AI的一种类型,生成式AI成为2023的“当红炸子鸡”。

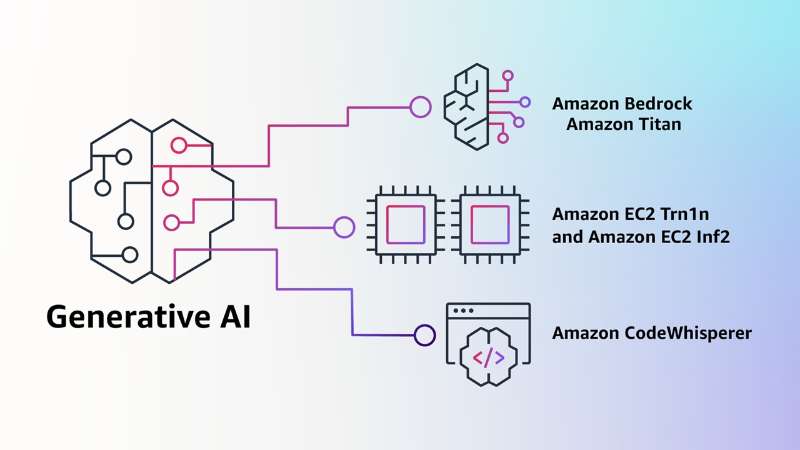

2023年4月13日,亚马逊云科技在美国一口气发布了生成式人工智能服务Amazon Bedrock、自有大语言模型Amazon Titan,并宣布Amazon EC2 Trn1n和Amazon EC2 Inf2实例正式可用、以及2022 年推出的自动代码生成工具Amazon CodeWhisperer正式可用,致力于将生成式AI技术从研究和实验领域释放,让各种技能水平的开发人员和各种规模的组织都有机会使用生成式 AI 进行创新。

“亚马逊云科技一直应用人工智能技术来为我们的自身业务、为各行各业不同规模的客户提供赋能。在人工智能、机器学习和堆栈这三个层级,我们都拥有非常多的产品组合。” 亚马逊云科技大中华区产品部总经理陈晓建在接受笔者的采访时表示,在生成式 AI领域,亚马逊云科技同样致力于推动技术的普惠化,让更多公司都能从中受益。

Amazon Bedrock是一项全新的生成式AI全托管服务。通过API用户可以访问亚马逊云科技和第三方基础模型提供商的预训练基础模型,即 Foundation model。Amazon Bedrock是客户使用基础模型构建和扩展生成式AI应用程序的最简单方法,降低了所有开发者的使用门槛。

作为全托管服务,用户不用担心后端所使用的各种基础资源的申请、管理和各种运营的服务,可以完全把这些工作交给亚马逊云科技,交给Amazon Bedrock来执行;通过提供亚马逊自身所实现的大模型以及第三方模型,用户可以为其场景选择最适合自己应用场景的模型;同时可以帮助用户定制模型;在安全加密方面,所有用户环境都基于自身的VPC(私有网络环境),与其他客户完全隔离。

值得一提的是,Amazon Bedrock和Amazon Sagemaker是两个独立的服务。Amazon SageMaker是亚马逊云科技很早就推出的端到端的机器学习平台,它的功能包括从数据标注到数据训练,再到部署,上线以后的持续监控,以及基于原始数据的再迭代等端到端的能力。

“Amazon Bedrock的定位是帮客户快速找到行业领先模型,并通过API的方式尽可能的不用自己去管理底层硬件和运维即可访问。” 亚马逊云科技大中华区数据技术专家团队总监王晓野透露,在做模型的调优和训练方面,Amazon SageMaker面向数据科学家,需要编写代码并提供数据以及添加参数去做模型和调优;在Amazon Bedrock方面,客户只需要提供少量已经标注好的数据,就可以很快展开,不需要编写太多的代码。

不过,在部署集成方面,Amazon SageMaker和Amazon Bedrock有一些结合点:客户可以将基础模型与Amazon SageMaker 机器学习功能集成,使用 Experiments 测试不同模型和使用Pipelines 大规模管理基础模型等。

当前,互联网公司包括国内和国际的互联网公司都在推自然语言大模型,亚马逊云科技也不例外。Amazon Bedrock已经预设了一些模型,包括亚马逊云科技通过多年实践所开发的两个基础大模型:Amazon Titan Text和Amazon Titan Embeddings;以及三个来自于AI21 Labs、Anthropic、Stability AI等第三方合作伙伴的模型。

其中,Titan Text是基于总结文本生成、分类、开放式回答和信息提取等任务的生成式大语言模型。Titan Embeddings是一个文本嵌入式的大语言模型,能够把文本的输入翻译成包含语义的数字表达。

“用户在使用大模型的时候,需要能够找到最合适他们业务场景的大模型与业务程序进行无缝集成,因为对to B的客户来说,所需要的生成式AI能力是希望能够为业务赋能。这就意味着需要找到一个办法——用大模型对业务重新进行赋能的同时,尽可能简单的使用大模型。很多客户可能不具备能力和时间从头搭建一个环境来训练自己的大模型,所以他们需要依赖于一些已有的大模型环境。”陈晓建认为,客户希望能够通过自己对行业的积累和理解,以及行业数据,能够对大模型进行定制化优化和重新训练,并确保数据和业务的安全。大模型是其中一个部分,但远远不是所有因素,他们更需要基础能力。

另外,未来大模型的发展应该会朝着多模态的方式去发展,通过这些通用的模型,用户在此基础上发展适合自己场景的细分行业模型,这有可能最后会成为常态。

需要注意的是,大模型的训练意味着高成本,亚马逊云科技提供最具成本效益的生成式AI云基础设施:推出配备Amazon Inferentia2芯片的Amazon EC2 Inf2实例,以及宣布配备AWS Trainium的Amazon EC2 Trn1n实例的全面可用性。Trn1n是一个网络增强型的新实例,相比于Trn1网络带宽提升了1倍,变成1.6TB,之前是800GB左右,旨在为大型的网络密集型的模型训练来使用;Inf2是亚马逊云科技自研推理芯片的第二代,相比第一代芯片不仅吞吐量提升了4倍、延迟降低了10倍,还实现了加速器之间的超高速网络连接,跟同类的Amazon EC2实例相比,性价比提升了40%,并且把云中推理成本降到最低。

例如,针对大模型部署,基于NLP自然语言处理的流行的模型,如果把同样模型部署到基于GPU的环境之中,需要有8个GPU卡才能完成。但是如果用Inferentia2,同样的负载只需要4个Inferentia2芯片就可以。这样一来,用户整个硬件部署的环境、复杂性、和成本资金都降低一半。

Amazon CodeWhisperer是亚马逊云科技提供的变革性生成式AI编程语言工具,现已面向所有个人开发者免费开放,支持10多种编程语言。CodeWhisperer可显著提高开发者的生产力,在预览期间可提高57%的任务完成速度和27%的任务成功率。

“CodeWhisperer是面对开发者的,它相当于一款插件,可以直接安装在现有的开发环境中,就可以享有CodeWhisperer的帮助。”王晓野强调,使用过程中,开发者可以通过注释的方式与CodeWhisperer交互,使得CodeWhisperer更像是开发者的智能助手,同时提供一些安全的扫描功能,例如检查开源授权等。

写在最后

从行业的发展趋势来看,生成式AI或许将带来机器学习的大规模应用。

在过去20多年里,亚马逊投入了大量资金用于开发和部署人工智能(AI)和机器学习(ML),用于为客户提供服务以及内部运营,包括从Amazon.com个性化购物体验的推荐引擎到优化仓库订单履行的AI驱动机器人。

目前,亚马逊云科技已经帮助超过10万个不同规模和行业的客户,利用行业领先的能力进行机器学习和人工智能创新。

“如何让用户更方便、容易的去使用生成式AI,从亚马逊云科技本身来看,为了让用户实现生成式AI的普惠化,不仅只是底层算力的环境,开放式的、多元的基础的大模型(Foundation model),还有能够为用户提供安全的、保证用户隐私的训练环境,以及就像CodeWhisperer这样在细分领域的解决方案。” 陈晓建认为,我们现在将见证机器学习的下一波广泛应用,无论客户体验还是应用程序都有机会通过使用生成式AI进行重塑。亚马逊云科技也会一直致力于通过服务、合作伙伴、芯片和开发者工具在生成式AI领域持续创新——所有的创新都以满足客户构建生成式AI应用程序的需求为基础。

艾瑞咨询AI首席分析师王紫萌认为:亚马逊云科技此次新品发布,涵盖底层基础大模型、基础模型全托管服务Bedrock、AI编程助手应用产品等,以及通过Inf2实例对模型的推理成本和性能进行优化,为客户提供了从模型定制化训练到应用落地管理的全链条生成式AI应用开发工具能力,帮助降低开发者的使用门槛。此轮生成式AI浪潮对数字经济产业的“变革”与“创新”不只是将AI能力融入到现有应用中,更将带来系统层面的再塑造:基于人机交互方式改变所带来的生产力革命、各领域各模态的AI-first应用诞生以及基于大模型开发的AI通用与泛化进程,AI能力的辐射圈和需求圈将不断扩大。亚马逊云科技在生成式AI服务上的全面布局体现了其在AI和机器学习领域的深厚业务积累与精准客户需求判断。

京公网安备 11010202008829号

京公网安备 11010202008829号